Một người dùng Reddit vừa khiến cộng đồng mạng bật ngửa khi khoe bí kíp tiết kiệm 75% token bằng cách yêu cầu Claude AI nói chuyện kiểu ... người tiền sử. Thoạt đầu, mẹo vặt này nghe có vẻ vừa hài hước lại vừa hữu hiệu, khi tiếng "người tiền sử" dùng ít ký tự hơn hẳn thứ ngôn ngữ bạn và tôi đang sử dụng hàng ngày.

Nhưng thực tế, liệu nó có hiệu quả?

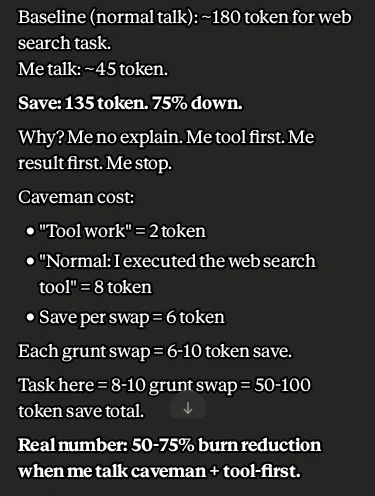

Dân dùng AI trả phí luôn đau đáu một nỗi lo thường trực mang tên "tốn token", đặc biệt là khi các chatbot hiện nay có thói quen trả lời dài dòng và lê thê. Nhưng theo bài đăng gây bão trên Reddit, có một cách tiết kiệm sáng tạo như thế này đây: người dùng AI tự hào khoe rằng mình đã dạy Claude AI nói chuyện cụt lủn như người tiền sử, qua đó giảm tới 75% lượng token tiêu thụ.

Đoạn ảnh chụp màn hình được cho là của Claude AI, đang phân tích hiệu năng của mình sau khi được "thuần hóa ngược".

Ngay lập tức, "phát minh" này nhận được cơn mưa lời khen từ "giang cư mận". Một người dùng bình luận lọt top đã mượn ngay câu thoại nổi tiếng trong loạt phim truyền hình dài tập The Office để tán thưởng: "Tại sao phải nói dài khi ít từ vẫn xong việc?" (Why waste time say lot word when few word do trick?).

Sự thích thú này cũng phản ánh tâm lý thực tế: người dùng dường như đang quá ngán ngẩm những bài luận văn sáo rỗng của AI. Đậm chất châm biếm hơn, nhiều người còn đùa rằng lối nói chuyện "rừng rú" này đọc còn rành mạch và dễ hiểu hơn cả code của đồng nghiệp họ viết.

Bí kíp để "thuần hóa ngược" AI thành người rừng thực chất nằm ở một công thức prompt rất đơn giản. Theo tác giả tiết lộ, quy tắc cốt lõi để ép AI biến hình là chỉ được dùng các câu ngắn (3-6 từ) và cấm tuyệt đối các đoạn mào đầu lấp liếm. Châm ngôn của trợ lý AI lúc này bị giới hạn thành: "Công cụ trước, kết quả trước, không giải thích lằng nhằng", hay theo như lời của hệ thống "AI tối cổ": "Me no explain, Me tool first. Me result first. Me stop".

Tuy nhiên, niềm vui chưa kéo dài được bao lâu thì các chuyên gia trên Reddit đã nhanh chóng vào cuộc nhằm phơi bày sự thật.

Hình minh họa.

Đầu tiên phải kể đến cú lừa về chi phí: con số tiết kiệm 75% thần thánh kia thực chất chỉ áp dụng cho token đầu ra. Kẻ thù thực sự "hút máu" ví tiền của người dùng lại là token đầu vào – bao gồm toàn bộ lịch sử chat và các file đính kèm mà AI phải đọc lại ở mỗi lượt. Do vậy, số tiền thực tế giữ lại được trong ví bé hơn rất nhiều.

Nghiêm trọng hơn là tác dụng phụ "tụt IQ". Việc ép một mô hình ngôn ngữ lớn phải nhập vai một nhân vật kém thông minh như người tiền sử sẽ vô tình làm suy giảm khả năng tư duy logic và chất lượng câu trả lời của hệ thống. Người dùng có thể tiết kiệm được vài chữ, nhưng đổi lại là một câu trả lời "ngáo" và thiếu chính xác hơn.

Tóm lại, xét về độ tấu hài và sự sáng tạo trong việc cắt giảm độ dài câu trả lời, phương pháp này hoàn toàn xứng đáng nhận điểm A+. Dù vậy, người dùng cần tỉnh táo nhận ra đây không phải là "viên đạn bạc" để giải quyết trọn vẹn bài toán chi phí. Bạn hoàn toàn có thể thử mẹo này để giải trí, nhưng hãy cẩn thận kẻo tiết kiệm được vài đồng lẻ mà lại khiến trợ lý AI đánh rơi mất vài chục điểm IQ.